Media y Varianza de una variable aleatoria continua

- Media

- Varianza

- Desviación tipica

Viernes, 06 de Enero del 2017

Distribución de Bernoulli

Es un tipo de distribución para una variable aleatoria discreta "x" en donde solo se toman dos opciones:

- Éxito: 1

- Fracaso:0

- P(Éxito)= p

- P(Fracaso)= q= 1-p

S{Exito,Fracaso}

x---Be(p)

p+q=1

x= número de éxitos en n ensayos de Bernoulli

donde:

x---- Bin (n;p)

x= número de éxtios

p= probabilidad de éxitos

q= probabilidad fracaso

La combinatoria de x entre n se puede expresar como:

Características

- n debe ser un numero finito

- cada ensayo puede tener dos resultados, éxito o fracaso

- todos los ensayos son independientes

Martes, 10 de enero del 2017

Distribución de Poisson

x~Po (λ)

P(x) = probabilidad de que ocurran "x" éxitos , cuando el número promedio de ocurrencia es λ

λ= media o promedio éxitos por unidad de tiempo, área o producto

x= número de éxitos que se desea que ocurra

Características

- Sucesos independientes

- x es una variable aleatoria discreta con valores enteros positivos

- Se da dentro de un intevalo de tiempo

- Lambda es un valor constate positivo (esperanza)

- si n > 29 y p < 0.05 entonces

- La esperanza y varianza está definida por:

Cuando nos dan un tiempo en el que ocurren los sucesos:

formula que representa la probabilidad de que r eventos ocurran en un tiempo t.

Viernes, 13 de enero del 2017

Distribución Geométrica

x---GEO(p)

donde

x: número de fracasos hasta el éxito

Características

- se realizan n pruebas hasta obtener el primer éxito

- se pueden obtener únicamente dos resultados, éxito o fracaso

- pruebas idénticas e independientes entre si

- la probabilidad de éxito p se mantiene constante.

p= probabilidad de éxito

q=1-p= probabilidad de fracaso

x= número de ensayos

Esperanza y varianza

Ejemplo:

Del salon el 60% de los alumnos

son hombres, calcular probabilidad de extraer el 1er hombre a la cuarta

ocasión que extraemos un alumno.

Definir éxito: sea hombre.

x = 4

p = 0.60

q = 0.40

Distribución Binomial Negativa

x---- NB(r,p)

donde

x: es el número de experimentos de Bernoulli de parámetro p independientes relizados hasta la consecución del r-ésimo éxito

r: número de éxitos

Características

- se pueden obtener únicamente dos resultados, éxito o fracaso

- eventos independientes entre si

- la probabilidad de éxito p se mantiene constante.

Esperanza y Varianza

Martes, 17 de Enero del 2017

Distribución Uniforme Discreta

Distribución Uniforme Discreta

Es una distribución de probabilidad donde la variable discreta "x" toma un finito número de valores con la misma probabilidad; a estos resultados se les denomina equiprobables debido a que todos ellos poseen la misma probabilidad de suceder. Donde:

Esperanza y Varianza

Características

- La variable aleatoria toma valores finitos cada uno con idéntica probabilidad.

- La varianza y esperanza de una v,a,d no depende de los valores que puede tomar la variable x sino únicamente del tamaño de la muestra

x: posibles resultados del dado

S: {1,2,3,4,5,6,7,8}

P(x=k) = 1/8

E(x) =9/2

Var(x)= 21/4

Distribución Hipergeométrica

Se refieren a los experimentos que consisten en tomar muestras sin reposición, de un conjunto finito, el cual contiene resultados considerados "éxitos" y "fracasos" .

Donde:

N: cantidad de elementos del conjunto del que se toma la muestra

k: cantidad de elementos que se consideran éxitos

n: tamaño de la muestra

x: v.a.d. Cantidad de resultados exitosos

Esperanza y Varianza

- Se puede considerar que la distribución hipergeométrica se aproxima a la distribución binomial si n< 0.05N, entonces X~Bi(n , k/N)

X~ u [a,b]

Características

- La probabilidad es constante en el intervalo [a,b]

- La probabilidad se determina en un intervalo, debido a que es una variable aleatoria continua

- La probabilidad en un punto es cero

Viernes, 20 de Enero del 2017

Prueba I del Segundo Bimestre

Martes,24 de Enero del 2017

Distribución Normal

Sea X~ N [µ ,σ]

Con una función de densidad:

Función de Probabilidad de Distribución

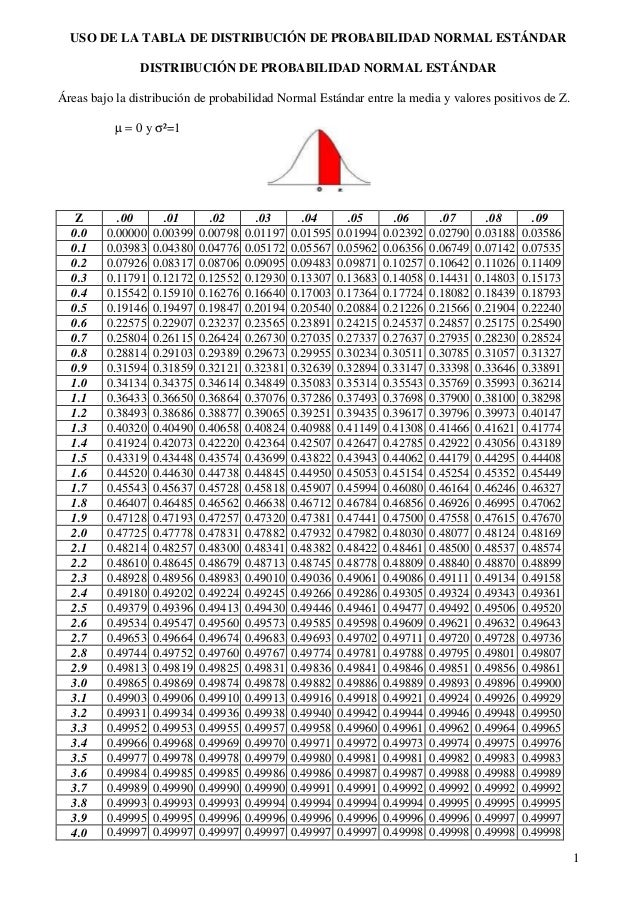

Distribución Normal Estándar

Sea z~ N [0,1]

donde z:

- P(Z>z)= 1-F(z)

- P(a<z<b)= F(b)-F(a)

-

P(ǀZǀ>z)= P(Z>z)+P(Z<z)=2[1-F(z)]

Para facilitar los calculos de probabilidad se utiliza una tabla tipificada con valores calculados preestablecido de la distribución normal estándar

Distribución Exponencial

Es una distribución continua ampliamente relacionada con la distribución de variable discreta denominada Poisson, generalmente se utiliza para estimar el tiempo de vida de un componente, se caracteriza por no tener memoria, es decir que el tiempo de estimación empieza una vez se comienza el experimento

Sea X~Exp(λ)

Función de densidad.

donde:

λ=coeficiente de razón

Esperanza y Varianza

Propiedades

- No tiene Memoria, no influye cuanto tiempo ha permanecido en ese estado

- Procesos independientes (Eventos que siguen un proceso de Poisson)

- Si xi,......,xn es una muestra aleatoria de Exp(λ) entonces el parámetro λ se estima con:

- La incertidumbre de la misma manera se calcula como:

Relación entre Poisson y Distribución Exponencial

x: Cuenta el n´´umero de eventros que ocurren en un tiempo [0,t] con una media λt entonces

donde:

r= 0,1,2,3

T= tiempo que transcurre hasta que sucede el rpimer evento de Poisson. El rango T es [0,+∞] y su distribución de probabilidad es:

F(t)= P(T<t)= 1- P(T>t)

F(t)= 1- P(x=0)

F(t) = 1- e^(-t)

Martes,31 de enero del 2017

Teorema del Límite Central

Sea x1,x2,....,xn una muestra aleatoria simple de una población con media u y varianza σ2

Sn= x1+x2+...+xn

Si n es demasiado grande entonces

Sn ~ N(nu,nσ2/2)

Propiedades

- Si el tamaño muestral es mayor a 30, la aproximación del teorema del limite central es buena.

- Tenemos una muestra aleatoria (son independientes e igualmente distribuidos), con una media comun u y σ2.

- Si x es la media de una muestra de tamaño n extraida de una población que tiene media u y varianza σ2, entonces:

- P(X∈[u-σ ;u+σ]) ~68%

- P(X∈[u-2σ ;u+2σ]) ~95%

- P(X∈[u-3σ ;u+3σ]) ~100%

No hay comentarios:

Publicar un comentario